Zeit für ein Update! Wir zeigen euch, was es mit Harmonize, Bildreferenz für Generatives Füllen und den neuen KI-Modellen in Photoshop 2026 auf sich hat

Mittlerweile haben wir wohl alle bereits mit Firefly in Photoshop experimentiert, neue Funktionen für uns entdeckt und fast vergessen, wie umständlich das Freistellen von Haaren früher einmal war. Aber mit Photoshop 2026 bringt Adobe einige neue Features, die ihr vielleicht noch nicht kennt. Wir zeigen euch unsere Top Picks – und wie sie sich in die Creative Cloud einfügen – an einem kleinen Workflow.

Mittlerweile haben wir wohl alle bereits mit Firefly in Photoshop experimentiert, neue Funktionen für uns entdeckt und fast vergessen, wie umständlich das Freistellen von Haaren früher einmal war. Aber mit Photoshop 2026 bringt Adobe einige neue Features, die ihr vielleicht noch nicht kennt. Wir zeigen euch unsere Top Picks – und wie sie sich in die Creative Cloud einfügen – an einem kleinen Workflow.

What’s new in Photoshop

Insgesamt stellte Adobe zur MAX 2025 über 12 neue Features (mit und ohne KI) vor. Einige davon nutzen ausschließlich Firefly, andere bieten mittlerweile auch die Auswahl zwischen den Adobe-eigenen und den integrierten Partnermodellen, wie Flux Kontext Pro und Nano Banana 3.

Wie immer gilt: Die Adobe-Modelle bieten wegen des Trainings auf Basis von Stockdaten einen gewissen Rechtsschutz. Bei anderen Modellen solltet ihr euch immer noch der rechtlichen Grauzone bewusst sein.

Mit der Integration der neuen Modelle eröffnet sich nun aber endlich die Option für iterative Prompt-Strukturen, die genauere Anweisungen ermöglichen, bei denen Teile des Bildes unverändert bleiben, während andere präzise angepasst werden können (mehr dazu später).

Unsere Favoriten in Photoshop 2026 und der Public Beta 27.2 sind aber eher subtilerer Natur. Sie erleichtern im Alltag die Bearbeitung und Collage von bestehendem Bildmaterial und erlauben es, schnellere und vor allem deutlich genauere Ergebnisse zu erzielen als noch vor wenigen Monaten.

Die Basis: Bildgenerierung mit Firefly

Einer der wohl größten Vorteile des cloudbasierten Generierens liegt in der schnellen Verknüpfung der Adobe Tools. So können wir seit PS 2026 jetzt direkt beim Öffnen der Desktop Apps auf unseren Generierungsverlauf aus Firefly zugreifen und ein zuvor generiertes Bild als Ausgangspunkt für unsere Exploration wählen.

In Firefly könnt ihr aktuell alle Modelle, inklusive einer Vorschau auf Firefly Image 5, kostenlos innerhalb eures CC-Abos testen. Innerhalb von Photoshop sind die Partnermodelle nur mit Creative Cloud Pro verfügbar und die Generierung kostet unterschiedlich viele Credits. Eine Übersicht findet ihr im Adobe Blog.

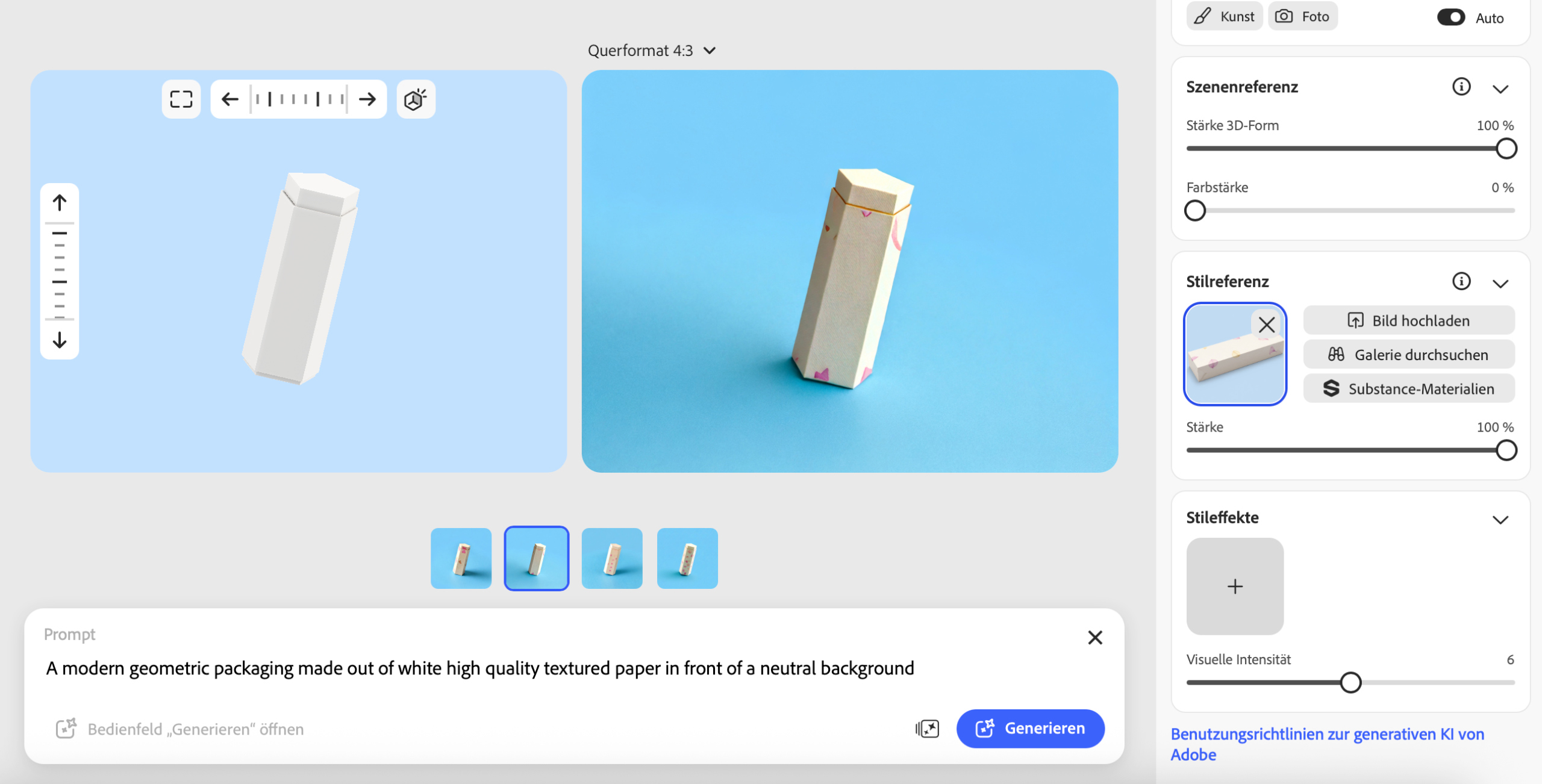

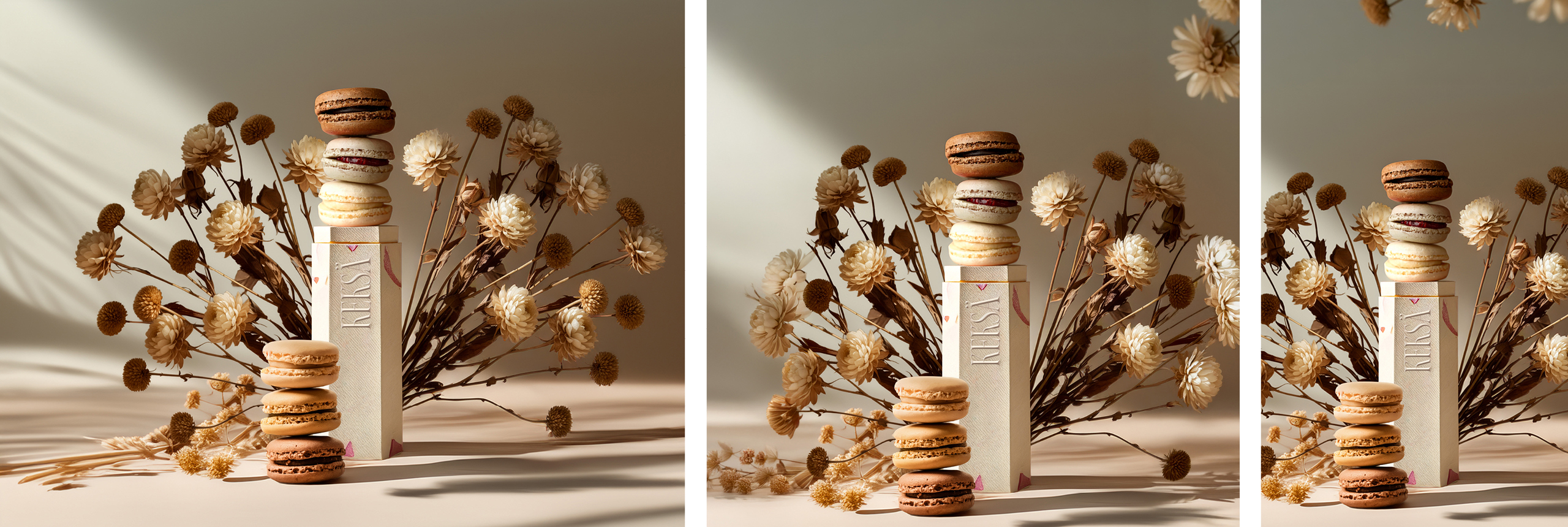

Wir haben für unser Projekt wieder auf die erprobte Kombination aus Project Neo und Firefly Web gesetzt. Mit Firefly generieren wir zunächst unsere Szene als Basis: ein Product-Shot für eine Keksmarke, inszeniert mit warmen Farben und Trockenblumen.

Das Packaging im Bild ist aber nur ein Platzhalter – für die Verpackung selbst modellieren wir die Form mit Project Neo (eine genaue Anleitung findet ihr hier) und nutzen eine mit Firefly generierte Materialreferenz, um so nah wie möglich an unser gewünschtes Ergebnis zu kommen. Die Kombination aus Basisbild und Packaging geht anschließend ganz einfach in Photoshop.

Beta: Generatives Füllen mit Referenzbild

Für den ersten Schritt begeben wir uns in die aktuelle Photoshop Beta 27.2, die ihr euch direkt in der Creative Cloud App herunterladen könnt. Darin sind nämlich schon einige neue Features sowie das verbesserte Firefly Modell für Generatives Füllen und Erweitern enthalten.

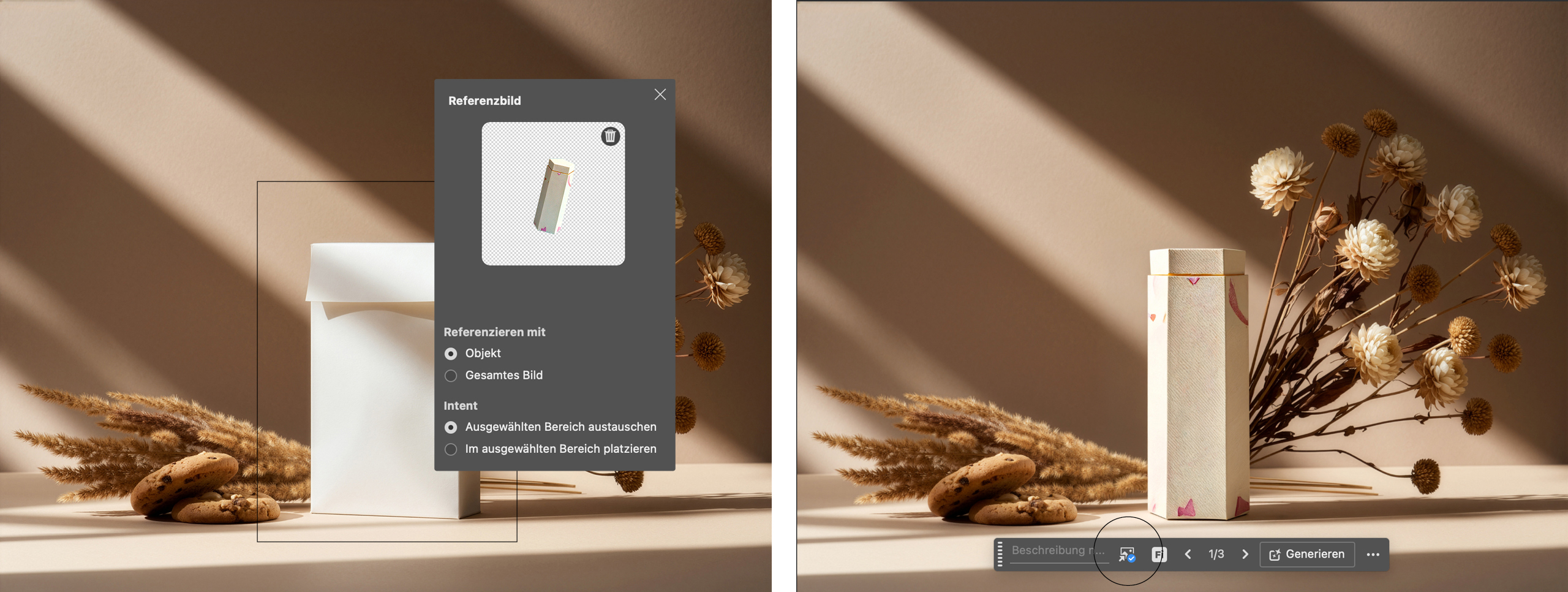

Über die Funktion Generativ Hochskalieren (Bild-Menü) vergrößern wir unser Bild aus Firefly, sodass wir mit mehr Details und höherer Auflösung arbeiten können. Anschließend wollen wir die Platzhalter-Packung mit unserem modellierten Packaging austauschen.

Dazu wählen wir grob das Packaging im Bild aus und klicken in der KI-Kontextleiste auf Generatives Füllen und das Bildsymbol, das nun rechts von der Texteingabe erscheint. Im Pop-up wählen wir nun unser modelliertes Packaging als Referenzbild. Hier gibt es die Option, entweder nur das gezeigte Objekt einzusetzen oder das gesamte Bild in die Komposition einzufügen.

Wir nutzen nur unser Objekt, das Photoshop automatisch freistellt, und klicken auf »Ausgewählten Bereich austauschen«. Nach wenigen Sekunden erhalten wir das Ergebnis: Photoshop hat unser Modell im Bild platziert, die Perspektive entsprechend angepasst und die Lichtverhältnisse automatisch harmonisiert. Praktisch für alle, die mit bestehenden Product-Shots arbeiten und nur Hintergründe und Setting ändern möchten.

Achtung: Photoshop setzt bei dieser Funktion eher auf den Realismus des Gesamtbildes als auf die perfekte Übernahme der Referenz. Wer also exakte Bildvorgaben hat, an denen nichts verändert werden darf, sollte lieber mit dem Harmonize-Feature arbeiten. Wir haben beides getestet.

Harmonize: realistische Collage auf Knopfdruck

Harmonize ist seit wenigen Wochen in Photoshop 2026 verfügbar und immer in die Kontextleiste integriert. Kurzgesagt erlaubt Firefly uns damit, selbst freigestellte Elemente an genau der Stelle und mit gewünschter Größe im Bild zu platzieren und sie dann mit einem Klick an Lichtverhältnisse, Tonwerte und Schatten anzupassen.

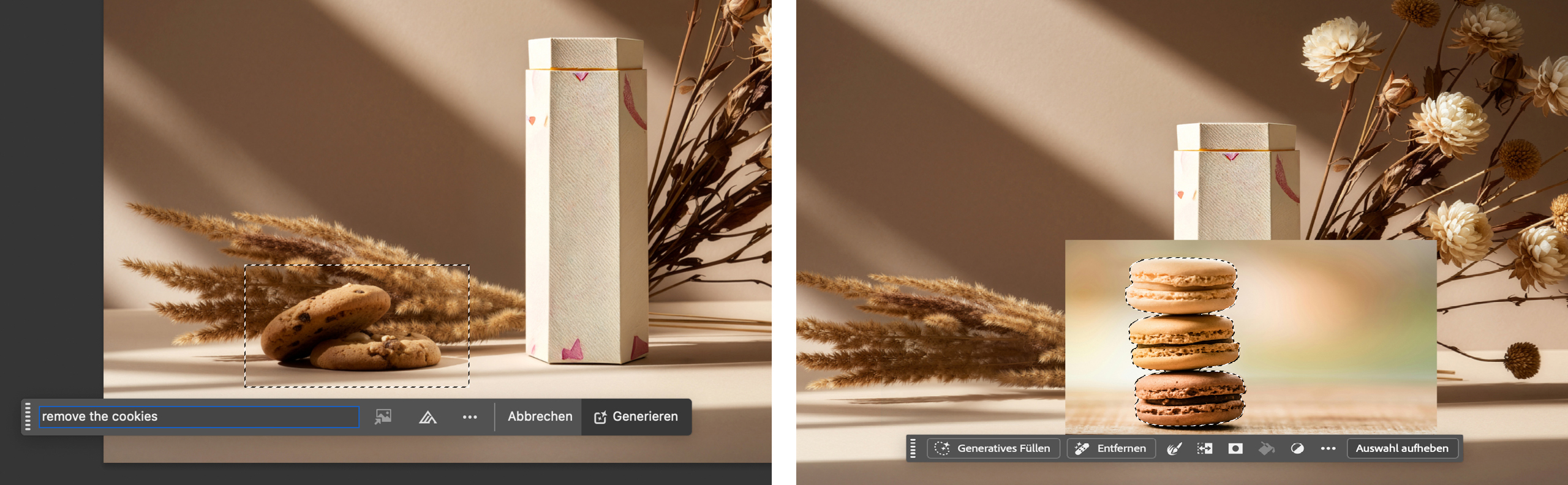

Wir testen das mit den Macarons, für die unser Visual am Ende werben soll. Dafür hatten wir zuerst getestet, die beiden Cookies im Vordergrund mittels eines Referenzbildes auszutauschen, aber das Ergebnis verzerrt zu sehr die tatsächlichen Produktbilder.

Stattdessen entfernen wir die Cookies mit dem Button in der Kontextleiste und platzieren und maskieren anschließend ein Produktfoto der Macarons an der gewünschten Stelle. Die angewählte Ebene können wir dann entweder über einen Rechtsklick oder über den Harmonize-Button in unsere Szene integrieren lassen, ohne dabei unser Produkt grundlegend zu verändern.

Detail-Editing mit Flux Kontext

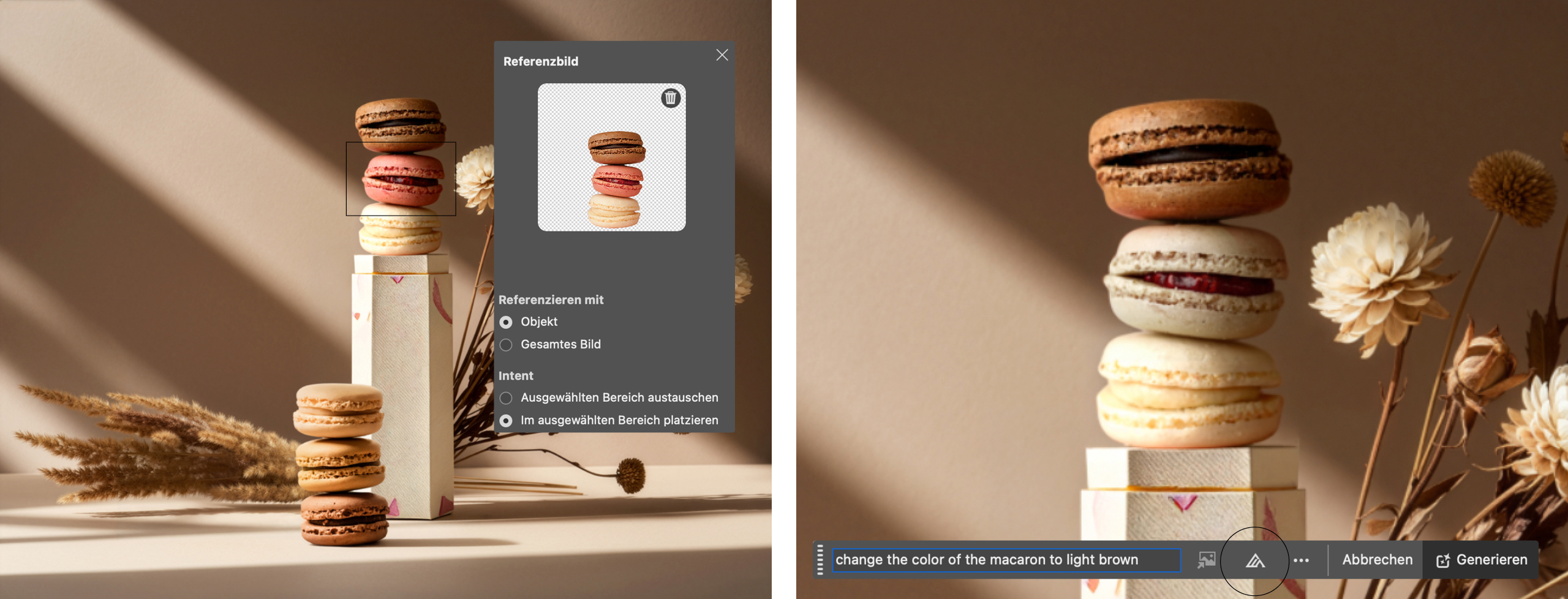

Einen zweiten kleinen Turm aus Macarons wollen wir jetzt auf der Verpackung selbst platzieren. Mit dem neutralen Hintergrund können wir hier einfach Generatives Füllen mit Bildreferenz nutzen und die Funktion »Objekt platzieren« auswählen. Dadurch verändert sich leicht die Szene (erkennbar an der Oberkante des Packagings), um für die drei neuen Macarons Platz zu schaffen.

Das hier verwendete Referenzbild passt allerdings wegen des roten Macarons in der Mitte farblich nicht ganz in unsere Szene. Das lässt sich jetzt in Photoshop mit dem neu integrierten Flux Kontext Pro Model schnell ändern: mit einer groben Auswahl und einem Prompt, der sich spezifisch auf die gewünschte Farbe des Macarons bezieht.

Flux eignet sich für solch kleine, detaillierte Änderungen besser als Firefly, da das Modell feiner in der Anpassung einzelner Elemente und Harmonie der Szenen ist. Ihr findet die Auswahlmöglichkeit für die verschiedenen Modelle rechts von der Textleiste.

Freistellen und Hintergründe generieren mit Firefly

Die so generierte Szene könnten wir bereits verwenden, um erste Moods für eine Produktkampagne zu visualisieren. Wir gehen aber noch einen Schritt weiter und verfeinern das Bild, indem wir etwa mit Generatives Entfernen zunächst die Elemente entfernen, die uns stören und dann über die Kontextleiste das »Motiv auswählen« lassen.

Mit der verbesserten Genauigkeit bei der Auswahl erfasst Firefly jetzt auch kleinere Details, wie etwa die Feinheiten in den Trockenblumen, so genau, dass wir direkt aus der Kontextleiste eine Maske erstellen und weiterarbeiten können.

Um den Hintergrund weiter zu verändern, invertieren wir die Maske und generieren im ausgewählten Bereich eine neue Szene. Diese bleibt wegen der Kontext-Awareness der neueren Firefly-Modelle direkt passend zur Lichtsituation unseres Motivs.

Zuletzt wollen wir noch die Trockenblumen aus dem originalen Bild auf die andere Seite des Packagings spiegeln. Dazu duplizieren wir den Bildausschnitt und fügen ihn auf einer Ebene unter unserem maskierten Packaging ein. Mit dem Harmonisieren-Button können wir dann die Lichtstimmung so anpassen, dass zwar die Symmetrie bestehen bleibt, aber sich die Blumen dennoch realistisch in die Szene einfügen.

Feinschliff und verschiedene Formate

Zuletzt wollen wir für unsere fiktive Macaron-Brand noch ein Logo auf dem Packaging einfügen. Firefly ist zwar mittlerweile deutlich besser in der Textgenerierung, aber mal ehrlich: Wer für eine Brand gestaltet, hat Vorgaben in der Schriftauswahl oder muss ein Signet exakt abbilden können – und nur weil wir KI nutzen können, ist sie nicht immer die beste Option.

Wir setzen daher einfach ein Textfeld mit unserem gewünschten Font und nutzen die Fülloptionen der Ebene, um eine erhabene Blindprägung anzudeuten. Allerdings nutzen wir anschließend noch einmal die Harmonize-Funktion, die den Schriftzug an die Lichtverhältnisse unserer Szene anpasst und sofort realistischer wirken lässt.

Dann sind wir bereit, mit Generativem Erweitern verschiedene weitere Formate für Social Media Stories oder Posts zu erstellen. Dazu könnt ihr einfach blind generieren oder – wie wir – spezifischer steuern, was in den neu generierten Bereichen abgebildet werden soll.

Was wir von den neuen Features halten – und worauf wir uns noch freuen!

Alles in allem sind wir erst einmal beeindruckt. Nach der Adobe MAX gibt es immer einige neue Features zu entdecken, aber uns scheint, als hätte Adobe einen besonderen Fokus bei Photoshop gesetzt. So gibt es neben den AI-Features auch einige Verbesserungen an den Einstellungsebenen und anderen bekannten Tools.

Unser Favorit aus dem Workflow ist das neue Harmonize-Feature, dicht gefolgt von der Referenz-Funktion für das Generative Füllen, auf die wir uns schon in der offiziellen Photoshop-Variante freuen. Bis dahin beschäftigen wir uns weiter mit der Beta, in der ihr immer wieder eine Vorschau darauf erhaltet, was in den nächsten Monaten passiert.

Verbesserungswürdig finden wir einige Details: etwa die Ungenauigkeiten, die beim Generativen Füllen manchmal zugunsten der Szenen-Harmonie einbaut. Das kann, besonders bei feinen Arbeiten, mehr Vorarbeit beim Freistellen nötig machen. Aber wer das Designhandwerk beherrscht, sollte auch damit keine Probleme haben.

Aber was kommt als Nächstes? Darauf hat Adobe bei der MAX bereits einen Ausblick gegeben und wir sind vor allem auf ein Feature sehr gespannt: den Creative Agent in Photoshop, der nicht nur in einem Chat Feedback zu Komposition und Kontrasten eines Designs liefern können soll (denkt nur an die Möglichkeiten für barrierefreies Design!), sondern auch auf Knopfdruck Ebenen passend benennt. Damit könnte Adobe den nächsten wichtigen Schritt machen, um Designer:innen zur Hand zu gehen.