Wie KI-Tools die Arbeit in Agenturen effizienter und kreativer machen

Bei der Erstellung von Präsentationen, als Inspiration fürs Brainstorming oder für schnelle Storyboards: KI kann den Alltag von Kreativen enorm erleichtern. Wir zeigen, was Creative AI in Agenturen kann!

Für viele Arbeitsschritte im Design gibt es bereits KI-Tools, die bald Mainstream sein dürften. Mit der Veröffentlichung neuer KI-Sprachmodelle wie GPT-4, Googles Bard sowie neuer Versionen der Bildgeneratoren DALL·E und Stable Diffusion wird sich die Entwicklung 2023 fortsetzen. Als Timesaver bieten sich schon heute zum Beispiel Extensions für spezielle Funktionen an, die sich in gängige Designsoftware integrieren lassen, etwa das Stability-Plug-in von Chris Cantrell zur Prompt-basierten Bildgenerierung direkt in Photoshop, das Magician-Plug-in von Diagram zur Generierung von Icons, Copytexten und Bildern in Figma oder auch das Einbinden von ChatGPT als inspirierenden Schreibassistenten in Google Docs. Einen ausführlichen Überblick aktueller Plug-ins für Kreativsoftware sowie weitere Anwendungen mit Künstlicher Intelligenz gibt es hier.

An so gut wie allen Stellen im Designprozess testen Agenturen bereits den Einsatz von KI. In der Strategie finden zum Beispiel generative Sprachmodelle in Form von Persona-Chatbots Verwendung. Diese ermöglichen es, über den gesamten Projektverlauf hinweg kontinuierlich und beliebig detailliert mit der Zielgruppe zu »sprechen«. Das ist um einiges nützlicher als statische Präsentationscharts. Dass sogenannte Large Language Models (LLMs) wie GPT mitunter auch Textabschnitte generieren, die weder wissenschaftlich noch faktisch korrekt sind, ist für die Nutzung als Personas in der Regel unproblematisch. Für diesen Anwendungsfall eignet sich ChatGPT sehr gut. Analysetools wie der SWOT Bot gehen deutlich über GPT-3 (die KI hinter ChatGPT) hinaus, um die Nachvollziehbarkeit von Quellen und Texten zu gewährleisten (siehe Seite 101).

Creative AI in Agenturen

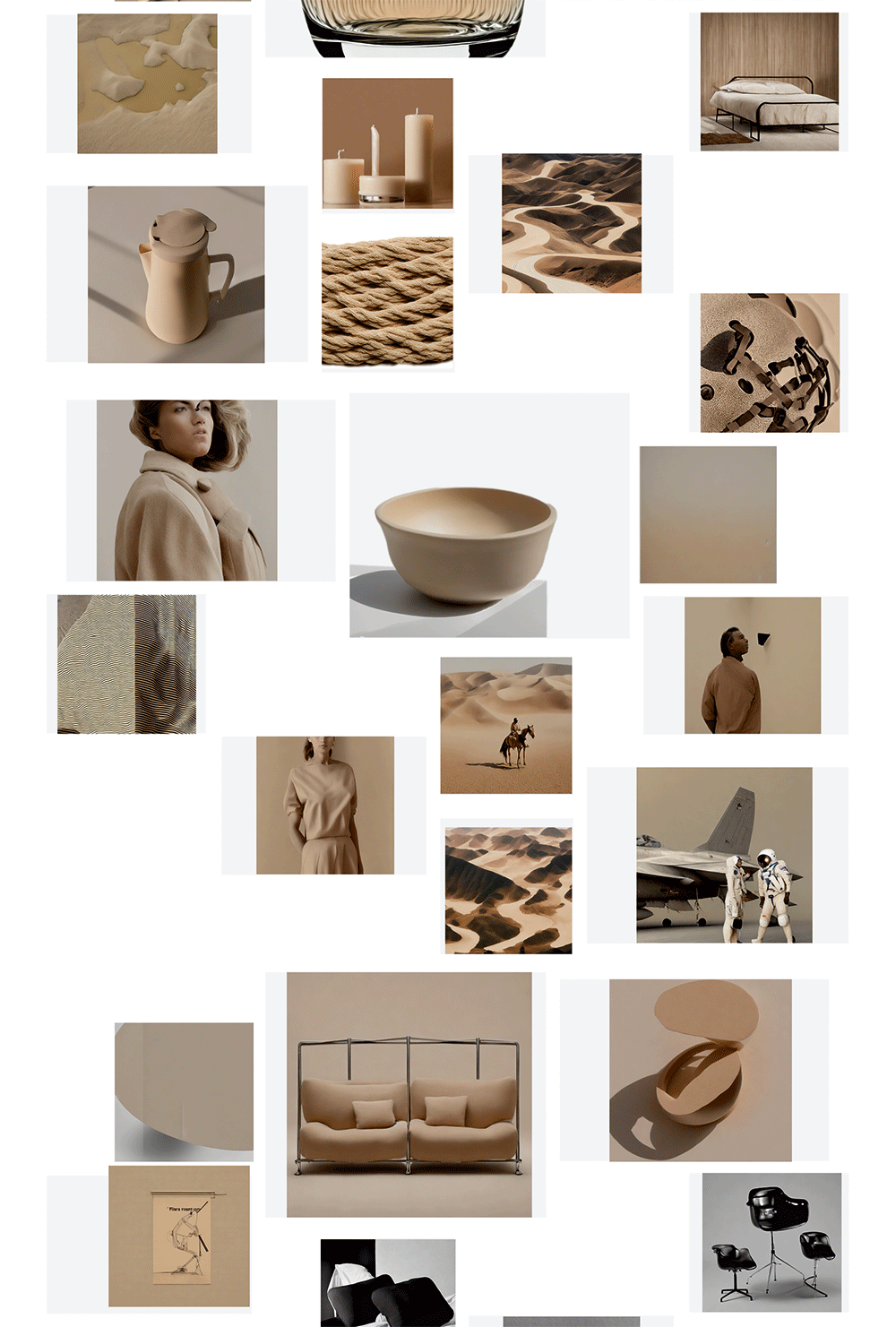

Gute Erfahrungen haben Agenturen auch mit dem Einsatz von generativen Bildmodellen für Filmproduktion und Pre-Production-Meetings gemacht. Sie ersparen stundenlanges Suchen bei Google, Getty Images, Pinterest und Co für die Erstellung von Moodboards oder Briefings für Location-Scouts und Set-Designer:innen. Dadurch können sich Kreative früher auf Regie und die kreativen filmischen Entscheidungen konzentrieren. Die meisten Bildgeneratoren haben zwar noch Probleme mit der Kohärenz bei menschlichen Körpern – besonders bei Gesichtern und Händen. Aber Detailfehler lassen sich zum Beispiel mit Funktionen wie dem sogenannten Inpainting beheben, bei dem Teilbereiche eines Bildes neu generiert werden, ohne die gesamte Komposition zu verändern.

- 3 Monate unbegrenzter Zugriff auf alle PAGE+ Inhalte

- PAGE-Update-Newsletter

- 3 x PAGE Impuls

- 1 PAGE Magazin frei Haus und digital als E-Paper

- Digitales Heftarchiv bis 2012

- Zusätzlich mehr als 100 eDossiers zu Spezialthemen

- Newsletter Daily und Weekly

Das könnte dich auch interessieren