Schopenstehl 15

20095 Hamburg

Deutschland

Weitere Standorte: New York

Anne-Marie Rädel-Aland

Human Relations + Studio Manager

jobs@indeed-innovation.com

+49 40 2846740-0

Unternehmensgröße: 11-50

Wie wird KI uns verändern?

Diese Frage stellten wir weit über 100 Teilnehmern des House of Beautiful Business in Lissabon 2017. Angelegt als Live-Research eruierten wir mit unserer Installation die Reaktion der Teilnehmer auf künstliche Intelligenz und künstlerische Verfremdung.

»How will AI change you?«, war die zentrale Frage unserer Installation:

Schritt 1 – Nehmen Sie Platz und denken Sie darüber nach, was uns im Zeitalter von KI erwartet.

Schritt 2 – Während Ihrer Bedenkzeit erstellen wir einen 3D-Scan von Ihrem Gesicht.

Schritt 3 – Geben Sie uns ein kurzes Statement, das Ihre Gedanken zusammenfasst.

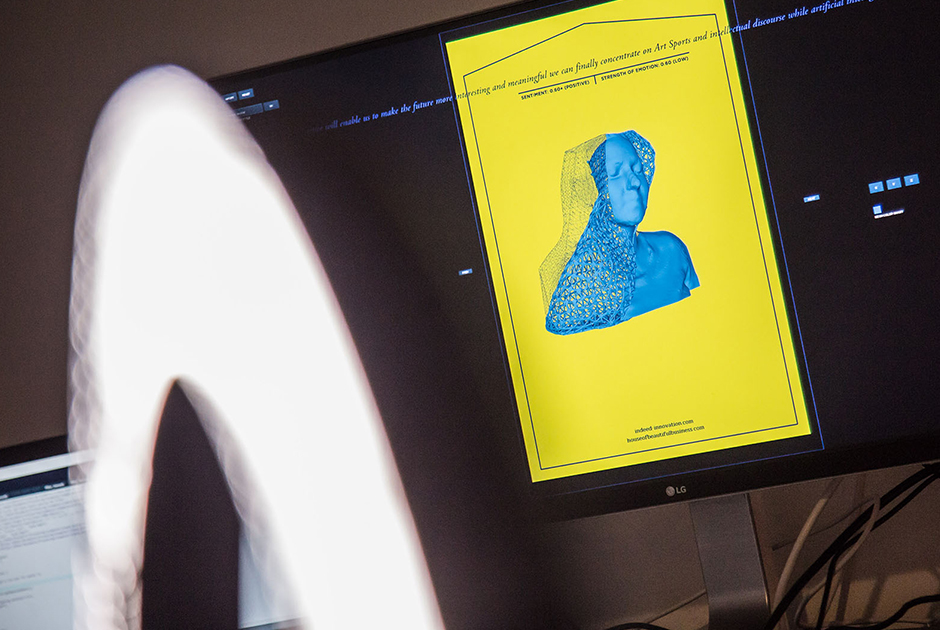

Schritt 4 – Das System analysiert Ihre Aussage. Das Ergebnis triggert die digitale Verzerrung Ihres Porträts mittels generativer Design-Software von INDEED.

Schritt 5 – Sie werden Teil unserer wachsenden Online-Galerie und erhalten Ihr individuelles Kunstwerk als Postkarte mit dem Ergebnis der Analyse.

Wo stehen wir heute, wohin geht unsere Reise? Alle Teilnehmer trugen zur Antwort auf diese Fragen bei und schafften so eine künstlerische Momentaufnahme der digitalen Transformation. Das spielerische, kontemplative Setting erlaubte den Teilnehmern die vorbehaltlose Auseinandersetzung mit dem Thema, ohne überbordende Datenschutzdiskussion oder moralischen Zeigefinger.

Das Setup für die Installation

Der minimal benötigte Platz beträgt 4 x 3 m. Daneben benötigten wir zwei Laptops für den Installationsbetrieb, ein Display zum Anzeigen der 3D-Scans und der Transformation, ein Mikrofon mit guter Rauschunterdrückung, einen Halbkreis-Dummy inklusive 3D-Scanner, sowie ein leistungsstarkes Beleuchtungssystem.

Die Software besteht aus zwei Modulen: Voice2Text und Data2Design. Das Sprachanalyse-Modul (in Python mit Google Cloud Platform geschrieben) nimmt das Nutzerstatement als Eingabe und schreibt den Kommentar automatisch in die Textdatei, während es den Stimmungswert des Benutzers extrahiert. Der Typ (positiv / negativ / neutral) und die Stärke (die Sicherheit des Gefühls) werden als Ergebnis der Stimmungsanalyse mit der Natural Language Processing Bibliothek aus der Cloud-Plattform von Google abgeglichen. Das Visual Processing Modul (geschrieben mit Toxiclib, HeMesh Bibliothek) lädt die gescannten 3D-Mesh-Daten des Benutzers und liest seine Sentiment-Daten (analysiert aus dem früheren Prozess). Zwei Trigger – Naturell und Stärke des Sentiments – werden zu den Hauptparametern, die die visuelle Verzerrung auslösen. Die 3D-Daten des Benutzers werden durch eine zufällig rotierende Ebene geschnitten, die das Netz teilt. Nur die Hälfte der Mesh-Daten unterliegt dem Verzerrungsschema. Die Distractive Distortion/Visualisierungskarte wird abhängig von der Art der Stimmung erstellt. Wenn die Stimmung negativ ist, neigt der Algorithmus dazu, Verzerrungen mit groteskeren Ergebnissen auszuwählen. Wenn ein positiveres Ergebnis vorliegt, wählt der Algorithmus Verfremdungen aus, die zu einem organischeren Ergebnis führen. Die Stärke des Gefühls entscheidet über den Grad der Verzerrung. Je mehr Gewissheit in den Kommentaren der Teilnehmer gefunden wird, desto stärker verzerrt die Mesh-Struktur. Am Ende der Transformation gibt das Programm eine Postkarte mit Farben aus der vordefinierten Farbpalette entsprechend dem Typ der Stimmung aus.

Schopenstehl 15

20095 Hamburg

Deutschland

Weitere Standorte: New York

Anne-Marie Rädel-Aland

Human Relations + Studio Manager

jobs@indeed-innovation.com

+49 40 2846740-0

Unternehmensgröße: 11-50